Los límites de uso de Claude se han convertido en una de las quejas más habituales entre usuarios intensivos de inteligencia artificial. La escena es reconocible: una persona está en mitad de una sesión de trabajo, escribiendo código, preparando textos, revisando documentos o construyendo una aplicación, y de pronto aparece el aviso de que ha agotado su cuota durante unas horas. Da igual que pague un plan avanzado. Si el flujo de trabajo consume demasiados tokens, el límite llega.

Un hilo publicado por Miles Deutscher en X ha vuelto a poner el tema sobre la mesa con una idea sencilla: muchas personas no llegan al límite porque Claude sea insuficiente, sino porque lo usan de una forma poco eficiente. Su propuesta no consiste en buscar trucos raros, sino en cambiar el método de trabajo: planificar antes, elegir mejor el modelo, evitar chats interminables y reservar los modelos más potentes para las fases donde realmente aportan valor.

El error más común: usar el modelo más caro para todo

Uno de los puntos centrales del hilo es que no todas las tareas necesitan el mismo modelo. Usar Claude Opus para cualquier cosa, desde una lluvia de ideas hasta una corrección menor, puede ser cómodo, pero también dispara el consumo. En la práctica, muchos usuarios tratan el modelo más avanzado como si fuera la opción por defecto, cuando debería reservarse para tareas difíciles, ejecución final o decisiones donde la calidad adicional marque la diferencia.

La recomendación es aplicar una especie de escalera: empezar con un modelo más ligero para tareas sencillas, pasar a uno intermedio cuando el trabajo lo requiera y usar el modelo más potente solo cuando haya que construir, depurar, cerrar una versión final o resolver un problema complejo. En el caso del ecosistema de Claude, eso se traduce en usar Haiku para tareas ligeras, Sonnet para trabajo intermedio y Opus para los casos más exigentes.

El cambio puede parecer menor, pero afecta mucho al consumo. Brainstorming, organización de ideas, clasificación de información o primeros borradores suelen requerir menos potencia. Lo que más gasta no es conversar con texto simple, sino pedir al modelo que programe, dibuje, construya, analice grandes cantidades de contexto o rehaga varias veces una misma tarea.

La diferencia entre improvisar y planificar también pesa. Si alguien empieza a construir una aplicación con dos minutos de preparación y luego tiene que rehacerla tres veces, probablemente gastará más tokens que otra persona que dedica veinte minutos a definir requisitos, estructura, pantallas, datos y restricciones antes de pedir una primera implementación. En inteligencia artificial generativa, planificar no ralentiza el trabajo: evita reconstrucciones caras.

De ahí la importancia de modos específicos como el “Plan Mode” de Claude Code. La idea es separar claramente dos fases: primero, pensar y organizar; después, construir. Cuando el modelo entiende que está en una fase de planificación, puede ayudar a definir mejor el objetivo sin lanzarse a generar código o artefactos pesados demasiado pronto.

Los chats largos también consumen más de lo que parece

Otro problema frecuente son las conversaciones eternas. Muchos usuarios reutilizan el mismo chat durante días o semanas porque quieren mantener el contexto. La intención es comprensible, pero el resultado puede ser contraproducente. Un chat muy largo obliga al modelo a trabajar con contexto antiguo, a veces irrelevante, y eso aumenta el consumo de tokens y puede empeorar la calidad de la respuesta.

Cada vez que se arrastra una conversación enorme, Claude tiene que interpretar más historial. Parte de ese historial ya no aporta nada. Peor aún, puede introducir ruido: decisiones descartadas, versiones antiguas de una idea, correcciones que ya no aplican o instrucciones contradictorias. La sensación de “memoria” puede terminar jugando en contra.

La alternativa es trabajar con proyectos y chats separados. En lugar de mantener una única conversación interminable para escribir, programar o analizar, conviene crear un proyecto con instrucciones estables y abrir un chat nuevo para cada tarea concreta. Así el modelo conserva las reglas importantes, pero no tiene que cargar todo el historial cada vez.

Otra técnica útil es pedir al propio Claude que genere un “prompt de traspaso” antes de cambiar de conversación. Algo tan simple como: “Voy a moverme a un nuevo chat; dame un prompt para continuar esta sesión sin perder el contexto importante” puede ahorrar muchos tokens. El modelo resume lo esencial, elimina ruido y permite empezar de nuevo con una base limpia.

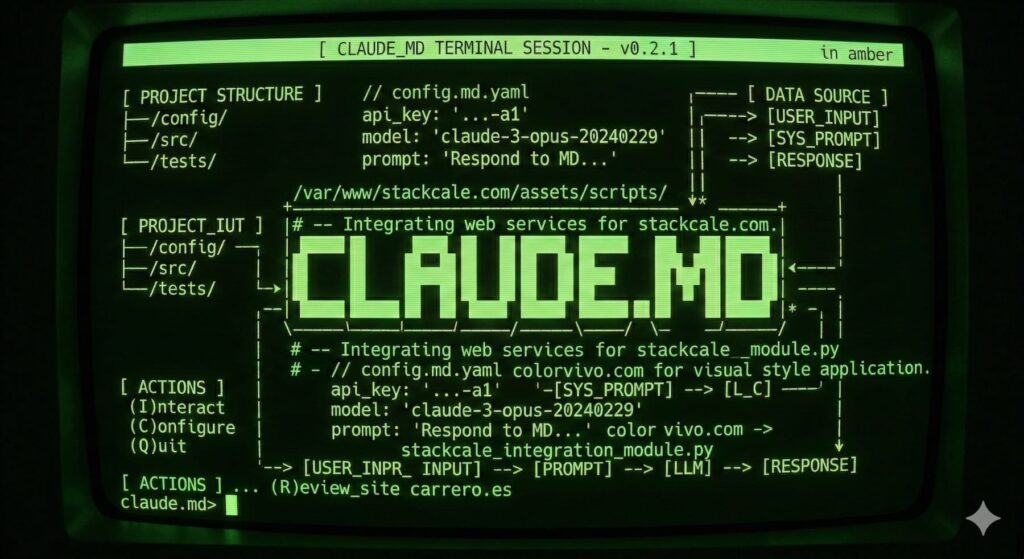

Deutscher también propone una forma más estructurada de memoria para usuarios de Claude Code o herramientas con acceso a archivos locales. Consiste en crear una carpeta con dos documentos Markdown. El primero, Instructions.md, recoge reglas permanentes: quién es el usuario, qué hace, cómo quiere recibir las respuestas, qué estilo prefiere y qué instrucciones deben respetarse. El segundo, Memory.md, funciona como registro vivo de preferencias, correcciones y patrones.

La clave está en pedir al modelo que actualice Memory.md cuando aparezcan nuevas preferencias. Por ejemplo, si el usuario dice “no uses rayas largas” o “prefiero respuestas más breves”, el modelo puede registrar esa corrección para futuras sesiones. Esto reduce la necesidad de repetir instrucciones en cada chat y evita gastar tokens en aclaraciones que deberían quedar guardadas.

Usar Claude mejor no significa usarlo para todo

La optimización también pasa por aceptar que no todas las tareas deben hacerse en Claude. Para scraping, búsquedas simples, clasificación inicial de datos, resúmenes poco delicados o tareas repetitivas de bajo valor, pueden servir modelos open source o servicios más baratos. Reservar Claude para el trabajo donde ofrece una ventaja clara ayuda a estirar los límites de uso y reduce costes.

También importa conocer las herramientas disponibles. Claude Chat, Claude Code y otros productos pueden compartir límites o tener parámetros distintos según el plan. En el hilo se menciona que Claude Design opera con límites separados, por lo que no tendría sentido gastar tokens de Claude Code diseñando elementos visuales si existe una herramienta específica para esa función. La regla práctica es usar cada herramienta para aquello para lo que fue creada.

Hay otros ajustes pequeños que suman: activar estilos concisos cuando se buscan respuestas cortas, reducir el esfuerzo de razonamiento en tareas sencillas, desactivar pensamiento extendido cuando no haga falta y revisar el uso acumulado antes de llegar al límite. En Claude Code, comandos como /usage ayudan a ver el consumo y evitar sorpresas.

El fondo del debate va más allá de Claude. La inteligencia artificial generativa se está convirtiendo en una herramienta diaria para profesionales, desarrolladores, creadores de contenido, analistas y equipos de producto. A medida que aumenta el uso, también crece la importancia de saber gestionar tokens, contexto y costes. La productividad no depende solo de tener acceso al modelo más potente, sino de usarlo con método.

La lección es bastante clara: los límites no siempre se evitan pagando más. A menudo se evitan trabajando mejor. Planificar antes de construir, dividir conversaciones, crear memoria reutilizable, elegir el modelo adecuado y no pedir a una herramienta cara tareas que puede hacer una más barata son hábitos que pueden marcar la diferencia entre una sesión fluida y un bloqueo en mitad del trabajo.

Para los usuarios intensivos, esta disciplina será cada vez más importante. Los modelos avanzados no serán infinitos ni gratuitos, y los planes de suscripción seguirán imponiendo restricciones. Quien aprenda a estructurar sus sesiones tendrá más margen, más control y mejores resultados. No es solo una forma de ahorrar tokens: es una forma más profesional de trabajar con inteligencia artificial.

Preguntas frecuentes

¿Por qué se agotan tan rápido los límites de Claude?

Normalmente por conversaciones muy largas, uso de modelos avanzados para tareas simples, generación repetida de código o artefactos y falta de planificación antes de pedir tareas complejas.

¿Qué modelo conviene usar para ahorrar tokens?

La idea es empezar con modelos ligeros para tareas sencillas, usar modelos intermedios para trabajo normal y reservar los modelos más potentes para tareas difíciles o versiones finales.

¿Es mejor usar un chat largo o varios chats pequeños?

Para ahorrar tokens y mejorar la calidad, suele ser mejor usar varios chats más cortos dentro de un proyecto con instrucciones estables. Un chat largo arrastra contexto innecesario.

¿Qué es un prompt de traspaso?

Es un resumen generado por el propio modelo para continuar una tarea en un nuevo chat sin perder lo importante. Sirve para evitar conversaciones interminables y reducir contexto inútil.