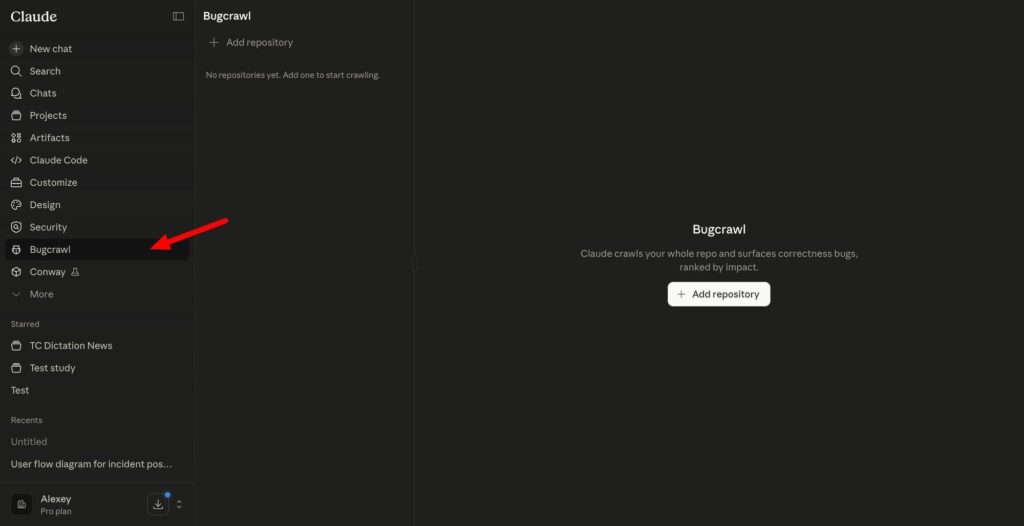

Anthropic estaría preparando una nueva función para Claude Code llamada Bugcrawl, orientada a analizar repositorios completos en busca de errores de programación y posibles fallos de lógica. La herramienta aún no aparece como una función estable ni ha sido anunciada oficialmente por la compañía, pero las primeras referencias detectadas por TestingCatalog apuntan a un nuevo paso en la evolución de Claude Code desde asistente de programación hacia una plataforma de revisión, seguridad y automatización para equipos de desarrollo.

La idea es sencilla de explicar, aunque difícil de ejecutar bien: permitir que Claude recorra una base de código, identifique problemas, proponga correcciones y ayude a los equipos a convertir ese análisis en trabajo accionable. Si se confirma su lanzamiento, Bugcrawl se situaría entre las funciones de revisión de pull requests y las capacidades de análisis de seguridad que Anthropic ya ha incorporado a Claude Code durante los últimos meses.

Una función aún en pruebas, no un lanzamiento oficial

La información disponible indica que Bugcrawl aparece como una entrada específica dentro de la navegación lateral de Claude Code. Al acceder a ella, la interfaz mostraría un selector de repositorios y una advertencia clara: el análisis consume tokens a un ritmo elevado, por lo que Anthropic recomendaría comenzar con repositorios pequeños antes de pasar a proyectos más grandes.

Ese aviso ofrece una pista importante sobre el tipo de trabajo que realizaría la herramienta. No se trataría de una simple revisión de unas pocas líneas modificadas, sino de una exploración más amplia del código fuente, con capacidad para examinar relaciones entre archivos, flujos de ejecución, dependencias internas y posibles errores que no siempre aparecen en un diff de pull request.

TestingCatalog interpreta que Bugcrawl podría “soltar” a Claude sobre un repositorio entero para buscar bugs generales y proponer soluciones. El enfoque sería distinto al de Claude Code Security, que está centrado en vulnerabilidades, y también diferente al de Code Review, que analiza cambios concretos en pull requests. Bugcrawl cubriría una categoría más amplia: fallos de calidad, regresiones, errores de lógica, casos límite rotos y comportamientos inesperados.

Conviene subrayarlo: por ahora no hay fecha de lanzamiento confirmada ni documentación pública oficial de Anthropic sobre Bugcrawl. La función parece estar en fase de prueba o preparación, así que sus capacidades finales, disponibilidad, precios y límites podrían cambiar antes de llegar a los usuarios.

Cómo encaja Bugcrawl en la estrategia de Claude Code

Claude Code se ha convertido en una de las piezas más importantes de Anthropic para el mercado de desarrolladores. La herramienta ya permite trabajar con código desde el terminal, integrarse con GitHub, responder menciones en issues o pull requests, crear cambios, explicar bases de código y automatizar tareas dentro del flujo de desarrollo.

En febrero de 2026, Anthropic presentó Claude Code Security en una vista previa limitada de investigación. La compañía lo describió como una capacidad para escanear bases de código, detectar vulnerabilidades de seguridad y sugerir parches específicos para revisión humana. La idea no era sustituir al equipo de seguridad, sino ofrecer un sistema capaz de razonar sobre el código con más contexto que una herramienta estática tradicional.

Después llegó Code Review, una función documentada en Claude Code que analiza pull requests y publica comentarios en línea donde detecta problemas. Según la documentación de Anthropic, esta revisión usa una flota de agentes especializados que examinan los cambios en el contexto de todo el repositorio, buscando errores de lógica, vulnerabilidades, casos límite rotos y regresiones sutiles.

Bugcrawl encajaría como una tercera capa. Security mira vulnerabilidades. Code Review mira cambios concretos antes de fusionarlos. Bugcrawl podría mirar el proyecto de forma más global, incluso sin esperar a que alguien abra un pull request. Eso lo acercaría a un sistema de auditoría continua de calidad de software, aunque con el coste computacional propio de un agente que debe leer, razonar y contrastar muchas partes del repositorio.

Para los equipos de ingeniería, el valor potencial está en detectar errores antes de que lleguen a producción. Muchos fallos no son vulnerabilidades claras ni aparecen en tests unitarios. Pueden estar en una condición mal planteada, una validación incompleta, una interacción entre módulos, una migración de datos, un flujo de interfaz o una suposición antigua que dejó de ser cierta. Ahí los agentes de código tienen margen para aportar, siempre que sus hallazgos sean revisables y no generen ruido excesivo.

El coste en tokens será una de las claves

La advertencia sobre consumo elevado de tokens no es un detalle menor. Analizar un repositorio entero implica leer muchos archivos, mantener contexto, formular hipótesis, comprobar relaciones y, en algunos casos, proponer cambios. Todo eso tiene coste. Cuanto más grande sea el proyecto, mayor será el volumen de tokens necesario para una revisión útil.

Por eso Bugcrawl parece orientado, al menos en una primera fase, a equipos con planes Team o Enterprise, donde el coste de uso puede tener más sentido frente al valor de encontrar fallos antes de producción. Para un desarrollador individual, lanzar un rastreo completo sobre un repositorio grande podría ser caro o poco práctico si no existen límites claros, modos parciales o criterios de análisis configurables.

La cuestión no será solo cuánto cuesta, sino cómo se controla. Una herramienta de este tipo necesitaría permitir análisis por carpetas, ramas, módulos, lenguajes, rutas críticas o tipos de error. También tendría que distinguir entre problemas reales, recomendaciones discutibles y simples preferencias de estilo. Si cada rastreo genera decenas de avisos de baja calidad, el equipo dejará de usarlo. Si encuentra pocos problemas pero bien argumentados, puede convertirse en una pieza útil del flujo de desarrollo.

También habrá que ver cómo Anthropic gestiona la revisión humana. En software, una corrección sugerida por IA no debería aplicarse sin control. Un cambio aparentemente razonable puede romper compatibilidad, alterar una API, introducir una regresión o resolver un síntoma sin atacar la causa. El mejor uso de Bugcrawl, si llega al mercado, sería como sistema de detección y priorización, no como piloto automático sin supervisión.

Competencia entre agentes de programación

El movimiento de Anthropic encaja en una carrera más amplia. OpenAI empuja Codex y sus agentes de desarrollo, Google trabaja con Jules, xAI avanza con Grok Build y varias startups intentan ocupar el espacio entre IDE, revisión de código, testing, seguridad y automatización DevOps. La programación se ha convertido en uno de los terrenos donde la inteligencia artificial generativa ofrece un retorno más claro, pero también donde los errores pueden tener consecuencias más directas.

Los modelos actuales ya ayudan a escribir funciones, explicar código heredado, generar tests o revisar cambios. La siguiente etapa consiste en que razonen sobre repositorios completos y trabajen con más autonomía. Bugcrawl iría precisamente en esa dirección: no esperar una pregunta puntual del desarrollador, sino iniciar una inspección amplia y devolver hallazgos.

La diferencia entre una herramienta útil y una peligrosa estará en la precisión, el contexto y la trazabilidad. Un buen informe debe explicar por qué algo es un bug, dónde se produce, qué impacto puede tener, cómo reproducirlo y qué cambio propone. También debe reconocer la incertidumbre. En bases de código reales, muchas decisiones responden a compromisos históricos, dependencias externas o requisitos de negocio que no siempre están escritos en el repositorio.

Anthropic parece estar construyendo Claude Code como una capa de trabajo para equipos profesionales, no solo como un chatbot que escribe fragmentos de código. Bugcrawl, si finalmente se confirma, reforzaría esa lectura. La promesa no es que la IA programe sola, sino que ayude a los equipos a encontrar fallos, revisar mejor y reducir parte del trabajo repetitivo que consume horas antes de cada despliegue.

El interés es evidente. La prudencia también. Un rastreador de bugs basado en IA puede encontrar errores que pasan desapercibidos, pero no sustituye a las pruebas, la revisión técnica, la observabilidad ni el conocimiento del producto. En ingeniería de software, la confianza se gana con resultados repetidos, falsos positivos bajos y correcciones que resisten producción. Bugcrawl tendrá que demostrar justo eso.

Preguntas frecuentes

¿Qué es Bugcrawl de Anthropic?

Bugcrawl sería una función en pruebas para Claude Code que permitiría analizar repositorios completos y buscar errores de programación, regresiones o fallos de lógica.

¿Anthropic ya ha lanzado oficialmente Bugcrawl?

No hay un anuncio oficial ni una fecha de lanzamiento pública. La función ha sido detectada en pruebas y aparece descrita como una capacidad aún no disponible de forma general.

¿En qué se diferencia de Claude Code Security?

Claude Code Security está orientado a vulnerabilidades de seguridad. Bugcrawl apuntaría a bugs generales y problemas de calidad en el código, una categoría más amplia.

¿Por qué puede consumir muchos tokens?

Porque revisar un repositorio completo exige leer numerosos archivos, mantener contexto entre ellos, razonar sobre dependencias internas y generar hallazgos con posibles correcciones.