En la actualidad, la formación e inferencia de modelos fundamentales en el sector tecnológico han incrementado notablemente las necesidades computacionales. Estos modelos, utilizados para diversas aplicaciones avanzadas de inteligencia artificial, requieren grandes cantidades de capacidad de cálculo acelerado para garantizar un entrenamiento efectivo y un funcionamiento óptimo, planteando así un desafío para las infraestructuras informáticas tradicionales. Para responder a esta demanda, los sistemas deben ser capaces de distribuir eficientemente las cargas de trabajo entre varios servidores equipados con GPUs, optimizando a su vez la velocidad de desarrollo y el rendimiento.

En este desafiante escenario, Ray se erige como un marco de trabajo de código abierto que simplifica la creación, implementación y optimización de trabajos distribuidos en Python. Su modelo de programación unificado permite a los desarrolladores escalar aplicaciones desde un ordenador individual hasta un clúster distribuido, facilitando la gestión de tareas, actores y datos a través de API de alto nivel. Las características de Ray incluyen la programación eficiente de tareas, tolerancia a fallos y gestión automática de recursos, haciendo de este marco una herramienta indispensable para edificar un amplio espectro de aplicaciones distribuidas, ya sea en modelos de aprendizaje automático o en tuberías de procesamiento de datos en tiempo real.

Por su parte, Amazon SageMaker HyperPod es una infraestructura especialmente diseñada para el desarrollo y despliegue de modelos a escalas significativas. Este sistema no solo permite la flexibilidad en la creación y utilización de stack de software propios, sino que también ofrece un rendimiento óptimo mediante el posicionamiento preciso de instancias y una resiliencia sólida. La fusión de la resiliencia de SageMaker HyperPod con la eficiencia de Ray crea un entorno potente para escalar las cargas de trabajo de la inteligencia artificial generativa.

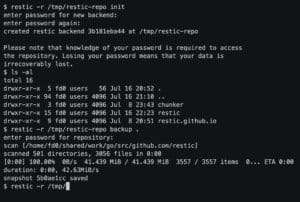

El artículo presenta un enfoque paso a paso sobre la ejecución de trabajos de Ray en SageMaker HyperPod, iniciando con una panorámica de las herramientas y marcos de Ray orientadas a tareas de inteligencia artificial y aprendizaje automático. Diseñado para ejecutar aplicaciones distribuidas altamente escalables y paralelas, Ray gestiona y optimiza las demandas computacionales de estas cargas de trabajo, proporcionando herramientas prácticas para la paralelización y escalado de flujos de trabajo que permiten a los desarrolladores concentrarse en la lógica de entrenamiento, liberándolos de las complicaciones relacionadas con la asignación de recursos y la comunicación entre nodos.

Además, se detalla cómo los clústeres de Ray pueden ser creados y gestionados usando Amazon Elastic Kubernetes Service (EKS) y el operador KubeRay, que facilita la implementación de una solución eficaz para el desarrollo y recuperación de trabajos distribuidos.

La resiliencia y capacidad de recuperación automática son componentes esenciales en la infraestructura de SageMaker HyperPod, permitiendo que los entrenamientos continúen incluso tras fallos en los nodos, aspecto crucial para trabajos de larga duración. Se enfatiza la importancia del uso de técnicas de checkpointing para asegurar que, en caso de interrupciones, el entrenamiento pueda reanudarse desde el último estado guardado, maximizando la eficiencia y reduciendo el tiempo total de entrenamiento.

Conforme las cargas de trabajo de inteligencia artificial y aprendizaje automático crecen en escala y complejidad, la combinación de Ray y SageMaker HyperPod brinda una plataforma escalable, resiliente y eficiente para abordar los desafíos computacionales más exigentes en este ámbito.