La implementación de asistentes impulsados por inteligencia artificial generativa se está convirtiendo en una práctica habitual entre las empresas que buscan optimizar sus operaciones y mejorar la eficiencia. Estos sistemas prometen revolucionar la forma en que las organizaciones manejan la información y automatizan tareas, sin embargo, antes de poder aprovechar su potencial, es imperativo garantizar su seguridad.

Antes de desplegar estas avanzadas aplicaciones, las organizaciones deben realizar una exhaustiva evaluación de preparación para la producción. Este proceso de evaluación abarca múltiples preocupaciones, entre las cuales la seguridad se destaca como una de las más críticas. La identificación inadecuada o la omisión de los riesgos de seguridad pueden no solo comprometer la aplicación, sino también retrasar significativamente su despliegue.

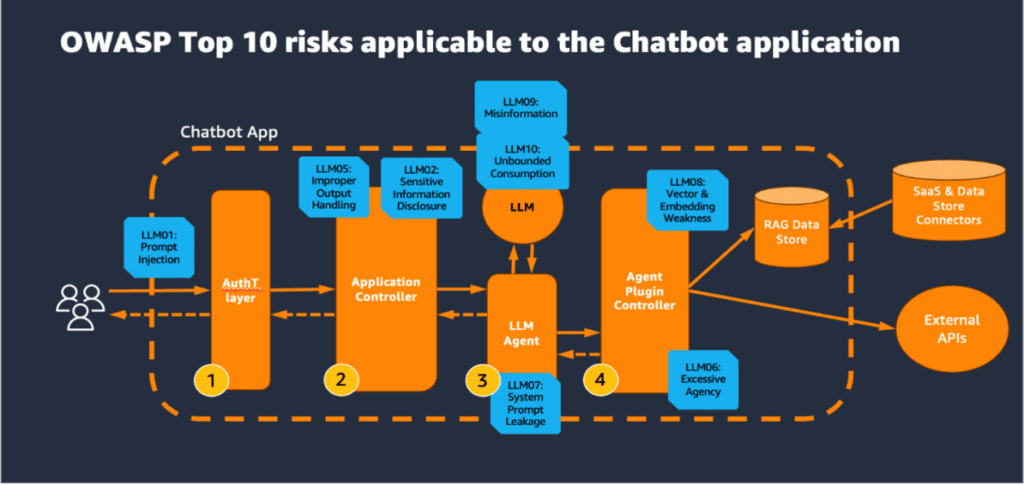

Para abordar estas inquietudes de seguridad, muchas organizaciones recurren al marco de evaluación de seguridad proporcionado por OWASP, que ha adaptado recientemente su Top 10 para Aplicaciones de Modelos de Lenguaje Grande (LLM). Este marco es esencial para ayudar a las organizaciones a identificar, comprender y mitigar las amenazas emergentes que enfrentan las aplicaciones de inteligencia artificial generativa. Ofrece pautas claras sobre las mejores prácticas de seguridad que deben seguirse para salvaguardar estas innovadoras tecnologías.

Un componente crucial en estas evaluaciones es el diseño de arquitecturas lógicas para las aplicaciones de inteligencia artificial generativa. Estas arquitecturas deben incorporar capas de seguridad efectivas, que incluyan desde la autenticación de usuarios hasta la gestión de la salida de datos generados por modelos LLM. Herramientas avanzadas como AWS Cognito y AWS WAF desempeñan un papel fundamental al validar a los usuarios y proteger las aplicaciones de ataques comunes, como los de denegación de servicio.

La implementación de medidas de seguridad adaptativas es igualmente vital. Estas incluyen la autenticación multifactor, el establecimiento de límites de tasa y la gestión segura de sesiones para prevenir accesos no autorizados. Además, es imprescindible que la capa de control de la aplicación, que a menudo es vulnerable a ataques como la inyección de comandos, esté reforzada con controles de seguridad robustos mediante una validación exhaustiva de entradas.

Conforme las aplicaciones de inteligencia artificial generativa continúan desarrollándose, la evaluación y mitigación de riesgos se vuelven elementos indispensables para asegurar que estas soluciones sean tanto seguras como eficaces en un entorno de producción. Adoptar un enfoque proactivo hacia la seguridad no solo protege las aplicaciones, sino que también fortalece la confianza de usuarios y clientes en el uso de estas tecnologías emergentes.