Amazon ha introducido una innovadora funcionalidad en su plataforma de inteligencia artificial SageMaker AI, que permite el ajuste fino de modelos GPT-OSS empleando recetas de SageMaker HyperPod y trabajos de entrenamiento. Este anuncio forma parte de una serie de publicaciones dedicadas a la optimización del modelo GPT-OSS para gestionar razonamiento estructurado en varios idiomas.

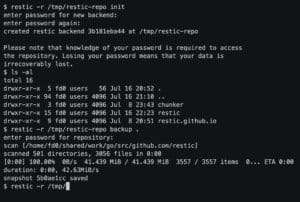

En la entrega inicial de la serie, se mostró cómo afinar modelos GPT-OSS usando bibliotecas de código abierto de Hugging Face a través de SageMaker. Ahora, las recetas de SageMaker HyperPod ofrecen a los usuarios una forma rápida y accesible de iniciar el entrenamiento y ajuste fino de modelos fundamentales de inteligencia artificial, como Llama de Meta y Mistral. Estas recetas incluyen configuraciones preconstruidas y validadas que facilitan la creación de entornos de entrenamiento distribuidos, garantizando un rendimiento y escalabilidad de nivel empresarial.

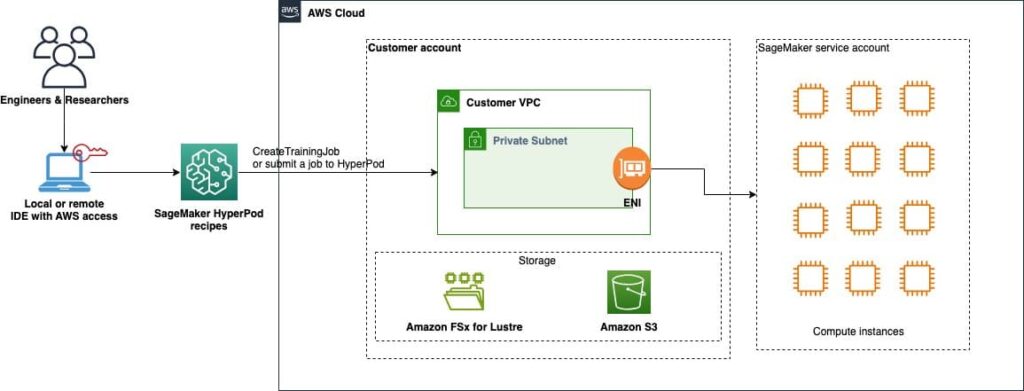

La solución utiliza SageMaker HyperPod para ejecutar trabajos de ajuste fino y facilita la orquestación mediante Amazon Elastic Kubernetes Service (EKS). Para emplear esta funcionalidad de manera efectiva, las organizaciones necesitan una configuración inicial que incluya un entorno de desarrollo local con credenciales de AWS y varias instancias del tipo ml.p5.48xlarge, entre otros requisitos.

El proceso de ajuste fino comienza con la preparación de un conjunto de datos adecuado, como el dataset «HuggingFaceH4/Multilingual-Thinking», diseñado para ejemplos de razonamiento en múltiples idiomas. Luego, tras la preparación y tokenización de los datos, se utilizan las recetas para someter el trabajo de ajuste fino y, finalmente, se implementa el modelo entrenado en un endpoint de SageMaker para pruebas y evaluación.

Expertos destacan que SageMaker no solo facilita la capacitación de modelos con recursos temporales, sino que también ofrece un entorno persistente para el desarrollo continuo a través de HyperPod, permitiendo a las organizaciones experimentar con modelos de forma más eficiente.

El despliegue de los modelos ajustados se efectúa utilizando contenedores optimizados en Amazon Elastic Container Registry (ECR), asegurando que las aplicaciones tengan acceso a los recursos necesarios para ejecutar inferencias en tiempo real. Además, SageMaker puede traducir configuraciones y preparar las variables adecuadas para un rendimiento óptimo.

En resumen, esta nueva funcionalidad abre un camino prometedor para que organizaciones de todos los tamaños aprovechen el potencial de los modelos de lenguaje grande, facilitando el ajuste y despliegue de modelos personalizados. Las guías y recursos están disponibles en los repositorios de GitHub de Amazon, que proporcionan ejemplos y documentación detallada para desarrolladores interesados en explorar esta tecnología.