El ecosistema que ha crecido alrededor de Claude Code acaba de sumar una derivada especialmente llamativa: OpenClaude, un proyecto en GitHub que promete ejecutar la experiencia de Claude Code con modelos distintos a Claude. Su propuesta central es un shim compatible con la API de OpenAI que, según el propio repositorio, permite conectar el sistema a GPT-4o, DeepSeek, Gemini a través de OpenRouter, modelos locales en Ollama, LM Studio y otros proveedores que hablen el formato de chat completions.

La idea tiene mucho gancho porque apunta a uno de los grandes deseos del mercado actual de agentes: separar la capa de herramientas y flujo de trabajo del modelo concreto que hay detrás. OpenClaude no intenta esconderlo. En su README se presenta como una forma de usar “Claude Code with any LLM — not just Claude” y sostiene que mantiene operativas las piezas más valiosas del entorno, desde la edición de archivos hasta las tareas encadenadas y el uso de herramientas de terminal.

En el momento de la consulta, el repositorio público mostraba más de 5.200 estrellas, unos 2.000 forks y 151 commits, una señal de que el interés por desacoplar este tipo de asistentes de un único proveedor está creciendo con rapidez. No es todavía un fenómeno masivo comparable a otros repositorios virales de los últimos días, pero sí lo bastante visible como para reflejar una tendencia clara: los usuarios quieren la experiencia del agente, no necesariamente quedar atados al modelo o a la empresa que la popularizó.

Un shim para cambiar el cerebro sin tocar el cuerpo

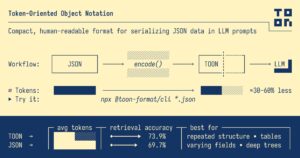

La clave técnica de OpenClaude está en una pieza concreta: src/services/api/openaiShim.ts. El repositorio la describe como una capa que se coloca entre la interfaz esperada por Claude Code y la API del modelo elegido, traduciendo formatos de mensajes, eventos de streaming y llamadas a herramientas. El objetivo es que el resto del sistema “no sepa” que está hablando con otro proveedor diferente. En su documentación, el proyecto afirma que esa traducción cubre mensajes de Anthropic hacia mensajes estilo OpenAI, llamadas de herramientas, eventos SSE y prompts de sistema.

Ese enfoque encaja con una realidad ya asumida por buena parte de la industria: la API compatible con OpenAI se ha convertido, de hecho, en una especie de idioma común para muchos servicios de IA. Aunque cada proveedor mantiene matices propios, el proyecto se apoya en esa compatibilidad para enchufar modelos muy distintos bajo una experiencia única. El propio repositorio lista ejemplos de configuración para OpenAI, DeepSeek, Gemini vía OpenRouter, Together AI, Groq, Mistral, Azure OpenAI, Ollama, LM Studio y hasta un backend de Codex mediante autenticación de ChatGPT.

En la práctica, OpenClaude intenta resolver una tensión que cada vez pesa más en los asistentes para desarrollo: los usuarios valoran mucho el entorno de trabajo, la lógica de herramientas, la edición en múltiples pasos, la memoria persistente y los subagentes, pero no siempre quieren pagar el precio o aceptar las limitaciones del proveedor original. Si una capa de compatibilidad consigue mantener esas funciones mientras cambia el modelo, entonces el foco pasa del LLM al runtime. Y ese es precisamente el cambio más interesante de este proyecto.

Qué promete mantener y qué pierde por el camino

OpenClaude asegura que conserva prácticamente toda la superficie de herramientas de Claude Code. En su README enumera bash, lectura, escritura y edición de archivos, glob, grep, WebFetch, WebSearch, Agent, MCP, LSP, NotebookEdit y Tasks, además de streaming en tiempo real, subagentes, cadenas de herramientas en varios pasos y un sistema de memoria persistente. Ese es el gran argumento del proyecto: cambiar el modelo sin perder el flujo operativo que hace valiosa la herramienta.

Pero el propio repositorio también reconoce diferencias importantes. OpenClaude dice que no mantiene el “thinking mode” de Anthropic, omite la caché de prompts específica de ese proveedor, ignora sus beta headers y trabaja con un límite por defecto de 32K tokens de salida, aunque aclara que algunos modelos pueden imponer topes inferiores. Es decir, la promesa de compatibilidad no equivale a clon exacto: hay una parte del comportamiento que depende del modelo y otra que depende del sistema original.

Ese matiz es importante para no sobreinterpretar el proyecto. OpenClaude puede ser muy útil para quien quiere experimentar con otros modelos dentro de un entorno similar, pero no garantiza por sí solo reproducir todas las optimizaciones o todos los rasgos de una implementación cerrada y muy afinada para un proveedor concreto. El propio repositorio recomienda modelos con buen soporte de tool calling y clasifica su calidad de forma aproximada, situando a GPT-4o como excelente en herramientas y calidad de código, a DeepSeek-V3 y Gemini 2.0 Flash en un nivel alto, y a modelos pequeños por debajo de 7B como opciones limitadas para este tipo de trabajo.

Del agente propietario al agente intercambiable

Lo que realmente hace interesante a OpenClaude no es solo su lista de variables de entorno o su compatibilidad con proveedores. Lo importante es la dirección que marca. Durante mucho tiempo, el valor diferencial de estas herramientas parecía residir en una mezcla inseparable entre modelo, interfaz, sistema de herramientas y lógica de ejecución. Proyectos como este empujan justo en la dirección contraria: convertir el asistente en una capa portable, donde el motor se pueda intercambiar casi como se cambia una base de datos o una pasarela de correo.

El propio proyecto lo resume bastante bien al indicar que solo ha necesitado seis archivos modificados, 786 líneas añadidas y cero dependencias nuevas para introducir su proveedor alternativo. Más allá de que esa cifra sea la manera en que el repositorio quiere presentar su elegancia técnica, el mensaje es claro: la capa de compatibilidad no tiene por qué ser gigantesca para abrir una herramienta a otros modelos.

También hay un ángulo legal y reputacional que no conviene pasar por alto. OpenClaude se define como un proyecto proporcionado “for educational and research purposes” y aclara que el código original sigue siendo propiedad de Anthropic y sujeto a sus términos. El repositorio además se presenta como un fork de una instantánea pública previa. Eso significa que, más allá de su valor técnico, se mueve en un terreno delicado donde la atención no se centra solo en la ingeniería, sino también en la legitimidad de la reconstrucción y en el marco de uso.

Aun así, en términos de mercado, el mensaje ya está lanzado. Si la experiencia de un agente puede encapsularse y redirigirse a 200 o más modelos mediante una compatibilidad estilo OpenAI, entonces la competencia futura en asistentes de programación no se jugará solo en el mejor modelo, sino también en quién controle mejor la capa de herramientas, el runtime y la experiencia operativa. Y ahí OpenClaude, aunque aún sea temprano, señala una línea de evolución difícil de ignorar.

Preguntas frecuentes

¿Qué es OpenClaude exactamente?

Es un proyecto en GitHub que se presenta como una forma de usar la experiencia de Claude Code con otros modelos, mediante un shim compatible con la API de OpenAI.

¿Qué modelos dice soportar?

El repositorio menciona OpenAI, DeepSeek, Gemini vía OpenRouter, Ollama, LM Studio, Mistral, Groq, Together AI, Azure OpenAI y un backend de Codex, entre otros.

¿Qué funciones mantiene del entorno original?

Según su README, mantiene herramientas como bash, edición de archivos, grep, glob, agentes, tareas, MCP, LSP, NotebookEdit, streaming y memoria persistente.

¿Es una copia exacta de Claude Code?

No. El propio proyecto admite diferencias como la ausencia del thinking mode de Anthropic, la falta de ciertas funciones específicas de ese proveedor y límites distintos según el modelo elegido.