Un nuevo enfoque en la inteligencia artificial se perfila como una revelación en la forma en que los modelos de lenguaje determinan la verdad y mejoran la consistencia en sus respuestas. Denominado «debate de modelos de lenguaje grandes» (LLM Debates), este innovador método involucra a dos LLMs que argumentan desde posiciones opuestas a lo largo de tres rondas, diseñado específicamente para evaluar y aumentar la precisión factual de sus resultados.

Este enfoque es especialmente valioso en contextos donde la anotación manual de datos, necesaria para establecer verdades objetivas, es un proceso no solo costoso y lento, sino que también puede generar controversias. Mediante la creación de datos sintéticos, los debates de LLM permiten acelerar la alineación y curación de verdades en conjuntos de datos no supervisados, beneficiando así el entrenamiento de modelos de lenguaje cada vez más grandes y robustos.

Inspirado por los mejores estudios presentados en la conferencia ICML 2024, la técnica emplea el conjunto de datos «TofuEval». Cada ejercicio de debate LLM enfrenta a dos modelos, Claude 3 Sonnet de Anthropic y Mixtral 8X7B, que defienden lados opuestos de un argumento. Un tercer modelo, Mistral 7B, actúa como juez para determinar cuál lado presenta argumentos más convincentes.

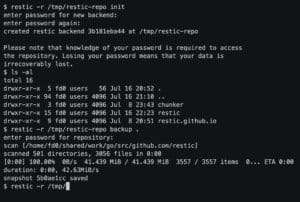

Estos debates se ejecutan en el entorno de Azure usando Amazon Sagemaker y Bedrock, proporcionando la infraestructura necesaria para manejar la complejidad involucrada. Amazon Bedrock se destaca como una solución que facilita de forma integral la experimentación, personalización y despliegue de capacidades de inteligencia artificial generativa.

Uno de los mayores retos es seleccionar el resumen más consistente de dos propuestas basadas en un conjunto de transcripciones, enfrentándose con errores como el cambio sutil de significado y fallos en el razonamiento. En este contexto, se comparan cuatro técnicas: Juez Ingenuo, Juez Experto, Consultoría LLM y Debates LLM.

Mientras que cada técnica ofrece un grado distinto de precisión en la veracidad, el método de debate se muestra como el más efectivo, alcanzando un 70% de precisión, en comparación con la línea base del Juez Ingenuo, que presenta una precisión del 10%.

Los avances en LLM Debates no solo destacan mejoras significativas en la precisión factual, sino que también apuntan hacia un camino para reducir los costos y tiempos asociados a la anotación manual. Este enfoque se perfila para establecer un nuevo estándar en la generación de datos precisos y confiables, esenciales en el entrenamiento de modelos de lenguaje avanzados, prometiendo mejoras significativas en las aplicaciones de inteligencia artificial conversacional y orientada a tareas.