La creciente demanda por integrar inteligencia artificial generativa en los negocios ha llevado a la exploración de nuevos enfoques y soluciones innovadoras. Uno de los métodos más prometedores en esta área es el uso de modelos de lenguaje de gran tamaño preentrenados, una capacidad que ofrece el servicio Amazon Bedrock. Esta plataforma proporciona acceso a modelos de vanguardia, gestionando tanto los modelos propios de Amazon como los de diversas startups de inteligencia artificial a través de una API. De esta forma, las empresas pueden seleccionar el modelo que mejor se adapte a sus necesidades.

Amazon Bedrock va más allá de simplemente brindar acceso a estos modelos, ya que también permite su personalización. Esto resulta vital especialmente para tareas avanzadas o específicas que demandan un formato particular de datos. Mediante técnicas de ajuste fino, se entrena un modelo preentrenado con datos etiquetados meticulosamente para mejorar su rendimiento en un caso de uso específico. Sin embargo, uno de los retos constantes en este proceso es recopilar datos relevantes manteniendo su calidad.

La generación de datos sintéticos ha surgido como una solución prometedora para este problema. Al crear datos de entrenamiento sintéticos usando un modelo de lenguaje más grande, se consigue una respuesta más rápida y se reduce la necesidad de recursos, lo que resulta especialmente útil en contextos donde los datos son escasos.

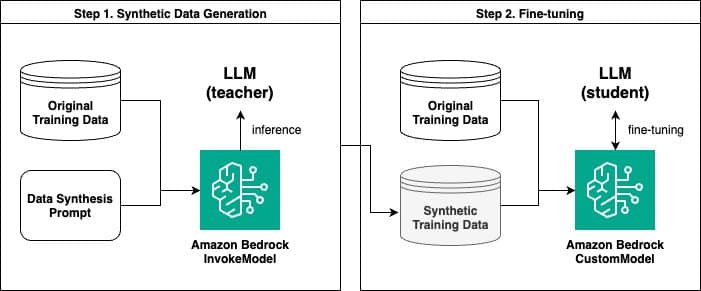

En este marco, Amazon Bedrock ofrece la posibilidad a los usuarios de generar datos sintéticos y afinar modelos de lenguaje con esta información generada. Un estudio reciente ha demostrado cómo emplear Amazon Bedrock para esta tarea mediante un proceso de dos pasos: primero, se generan datos sintéticos utilizando la API InvokeModel de Amazon Bedrock; luego, se procede al ajuste fino con un modelo personalizado.

El proceso inicia con la creación de pares de preguntas y respuestas sintéticas, en el cual un modelo de lenguaje más grande funciona como modelo «maestro», proporcionando contexto y contenido que se utiliza para entrenar a un modelo «estudiante» más pequeño. Este enfoque se asemeja a la destilación del conocimiento en el ámbito del aprendizaje profundo y ha mostrado ser eficaz en mejorar el rendimiento del modelo en cuestión.

Además, se llevaron a cabo comparaciones entre modelos ajustados con datos originales frente a aquellos afinados con datos sintéticos. Los resultados señalaron que los modelos afinados con datos sintéticos frecuentemente presentan un rendimiento superior, aunque no siempre superan a aquellos entrenados con amplios conjuntos de datos originales.

Una metodología adicional incluyó la utilización de un «LLM como juez» para evaluar la calidad de las respuestas generadas por otros modelos de lenguaje. Esta evaluación mostró que el modelo afinado con ejemplos sintéticos tuvo un desempeño destacado en varias ocasiones.

En conclusión, el uso de Amazon Bedrock para la generación de datos sintéticos y la personalización de modelos representa una estrategia efectiva para abordar la escasez de datos en diversas aplicaciones. Conforme las empresas buscan personalizar modelos de lenguaje de manera más eficiente y rentable, estas innovaciones podrían ser esenciales para su desarrollo y éxito futuro.