La evaluación del rendimiento de los modelos de lenguaje de gran tamaño (LLM) se ha convertido en una prioridad para las organizaciones que desean maximizar el potencial de esta tecnología en constante evolución. En este sentido, un nuevo marco llamado «LLM-as-a-judge» se ha introducido para simplificar y optimizar el proceso de evaluación de estos modelos. Este enfoque permite a las empresas medir la eficacia de sus modelos de inteligencia artificial mediante métricas predefinidas, asegurando que la tecnología se adapte a sus necesidades y objetivos específicos. Gracias a esta metodología, las compañías pueden evaluar con mayor precisión el desempeño de sus sistemas de IA, permitiéndoles tomar decisiones informadas sobre la selección, optimización y despliegue de modelos. Se anticipa que esta práctica no solo mejorará la fiabilidad y eficiencia de las aplicaciones de IA, sino que también proporcionará una estrategia más efectiva para adoptar la tecnología dentro de las organizaciones.

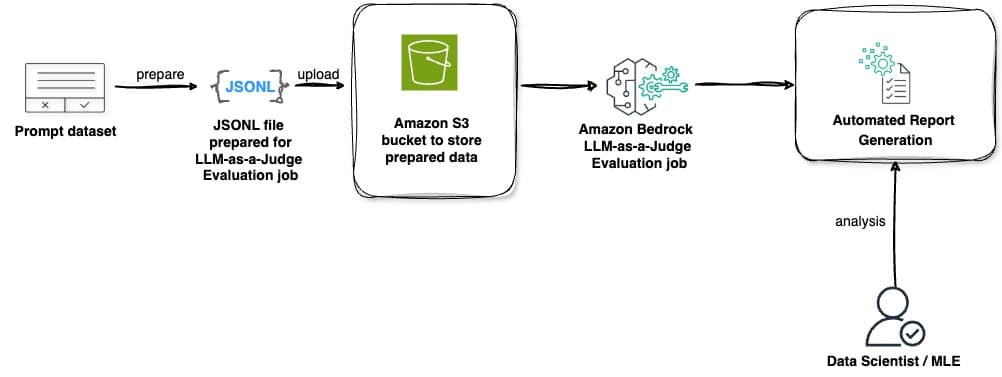

Amazon Bedrock, una plataforma gestionada que ofrece modelos de alto rendimiento de varias empresas de IA a través de una única API, ha incorporado estas capacidades. En las últimas semanas, ha introducido dos relevantes capacidades de evaluación: el uso de «LLM-as-a-judge» en la Evaluación de Modelos de Amazon Bedrock y la evaluación RAG para las Bases de Conocimiento de Amazon Bedrock. Ambas herramientas utilizan la técnica «LLM-as-a-judge» de manera complementaria, aunque se centran en diferentes aspectos de la evaluación. Este enfoque proporciona una orientación exhaustiva sobre la configuración de características, permitiendo la iniciación de trabajos de evaluación a través de la consola y APIs de Python. Además, muestra cómo esta innovadora característica puede mejorar las aplicaciones de IA generativa mediante la evaluación de múltiples métricas, tales como calidad, experiencia del usuario, cumplimiento de instrucciones y seguridad.

El método «LLM-as-a-judge» destaca por sus características innovadoras, que lo distinguen de los métodos de evaluación tradicionales. Una de sus principales ventajas es su capacidad para realizar evaluaciones inteligentes automatizadas, donde los modelos entrenados evalúan las respuestas de manera automática, alcanzando una calidad comparable a la evaluación humana con ahorros de costos de hasta el 98%. Este sistema abarca áreas cruciales de evaluación, como la calidad (corrección, integralidad, fidelidad), la experiencia del usuario (utilidad, coherencia, relevancia), el cumplimiento de instrucciones (seguimiento de directrices, estilo profesional) y el monitoreo de seguridad (prevención de daños, estereotipos, gestión de rechazos). La integración con Amazon Bedrock permite a los usuarios acceder a esta función a través de la consola de gestión de AWS, facilitando la carga de sus conjuntos de datos personalizados para tareas de evaluación.

El marco de evaluación «LLM-as-a-judge» proporciona una solución integral que ayuda a las organizaciones a optimizar el rendimiento de sus modelos de IA, mientras se mantienen altos estándares de calidad y seguridad. Con esta tecnología, las empresas pueden garantizar que sus aplicaciones de inteligencia artificial no solo sean eficaces desde un punto de vista operativo, sino también alineadas con sus objetivos estratégicos.