Meta ha lanzado al mercado su más reciente modelo de lenguaje, el Llama 3.3 70B, ahora disponible en la plataforma Amazon SageMaker JumpStart. Este nuevo avance en los modelos de lenguaje grande promete un rendimiento equiparable a modelos de mayor envergadura, pero con un uso significativamente reducido de recursos computacionales. Esta eficiencia no solo mejora la calidad y precisión de las respuestas generadas por el modelo, sino que también representa una reducción en los costos de operación, convirtiéndolo en una opción especialmente atractiva para las empresas y organizaciones que buscan desplegar modelos de lenguaje en su producción diaria.

El Llama 3.3 70B ha sido diseñado para operar de manera más eficiente, logrando resultados comparables a su predecesor, el Llama 3.1 405B, al tiempo que utiliza solo una fracción de los recursos. Según los informes de Meta, esta innovadora capacidad de eficiencia permite realizar casi cinco veces más operaciones de inferencia al mismo costo, ofreciéndose así como una solución más económica y viable para organizaciones de todos los tamaños.

En cuanto a su arquitectura, el modelo emplea una versión mejorada del conocido diseño de transformadores, integrando un mecanismo de atención optimizado que ayuda a reducir drásticamente los costos asociados con las inferencias. Durante su fase de desarrollo, el equipo de ingeniería de Meta entrenó el modelo con un vasto conjunto de datos, que incluye aproximadamente 15 billones de tokens. Estos datos combinan contenido extenso de la web con más de 25 millones de ejemplos sintéticos creados específicamente para perfeccionar los modelos de lenguaje grande. Este meticuloso enfoque en el entrenamiento ha otorgado a Llama 3.3 70B habilidades sólidas para comprender y generar respuestas en una variedad de tareas complejas.

Una de las características más destacadas de Llama 3.3 70B es su metodología de entrenamiento mejorada, que abarca un extenso afinamiento supervisado junto con el aprendizaje por refuerzo basado en comentarios humanos (RLHF). Este enfoque ha permitido que el modelo alinee sus salidas de manera más efectiva con las preferencias humanas, sin comprometer los estándares de rendimiento. En las evaluaciones de referencia, Llama 3.3 70B demostró una consistencia sorprendente, quedando a menos del 2% de diferencia con sus versiones más grandes en seis de las diez pruebas estándares de Inteligencia Artificial y superándolas en tres categorías distintas.

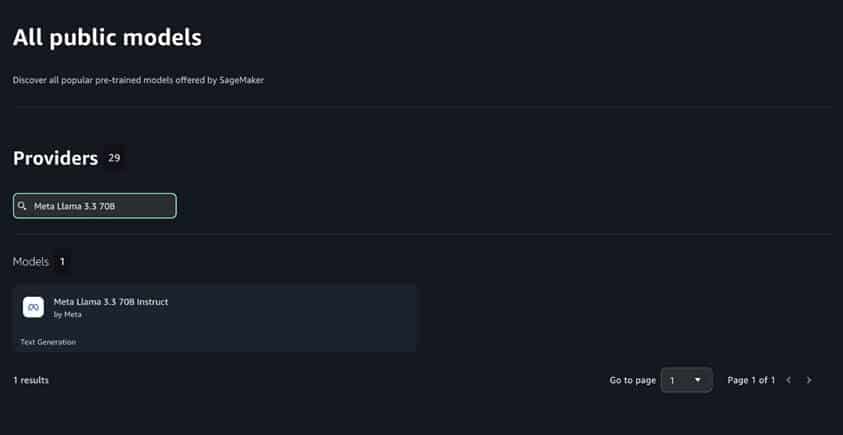

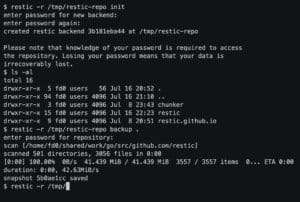

Para simplificar la implementación de este innovador modelo, SageMaker JumpStart provee herramientas útiles para la evaluación, comparación y selección de modelos preentrenados, incluyendo la nueva serie de Llama. Los usuarios tienen la opción de desplegar Llama 3.3 70B a través de una interfaz de usuario intuitiva o mediante un enfoque programático utilizando el SDK de Python de SageMaker, ofreciendo flexibilidad para adaptarse a las diversas necesidades de cada organización.

Las sólidas capacidades de SageMaker AI, tales como la carga rápida de modelos, el almacenamiento en caché de contenedores y la opción de escalar a cero, permiten una gestión eficiente de los despliegues, maximizando las ventajas de la arquitectura optimizada de Llama 3.3 70B sin incurrir en costos adicionales. Esta combinación de características avanzadas y herramientas de implementación ofrece una solución ideal para aquellas organizaciones que desean mejorar tanto el rendimiento como la eficiencia de costos en sus operaciones de modelado de lenguaje.