En un entorno de continuo avance en la infraestructura de inteligencia artificial, Amazon ha realizado innovaciones importantes en su plataforma SageMaker HyperPod. Esta actualización permite a los usuarios gestionar cargas de trabajo concurrentes de manera más eficiente al ajustarse dinámicamente a la disponibilidad de recursos. Gracias a un sistema de entrenamiento elástico, las tareas de aprendizaje automático pueden escalar automáticamente, optimizando el uso de las unidades de procesamiento gráfico (GPU), reduciendo costos y acelerando el desarrollo de modelos.

Tradicionalmente, las cargas de trabajo de entrenamiento de modelos de IA comenzaban con una configuración de recursos fija, lo que dificultaba la adaptación a cambios en la demanda de capacidad sin intervención manual. Este método condujo a menudo a un uso ineficiente de las GPUs disponibles, generando un significativo desperdicio de horas de cómputo y costos elevados. Las nuevas capacidades de SageMaker HyperPod resuelven este problema permitiendo que los trabajos de entrenamiento se adapten de manera dinámica a las fluctuaciones de recursos sin perder calidad.

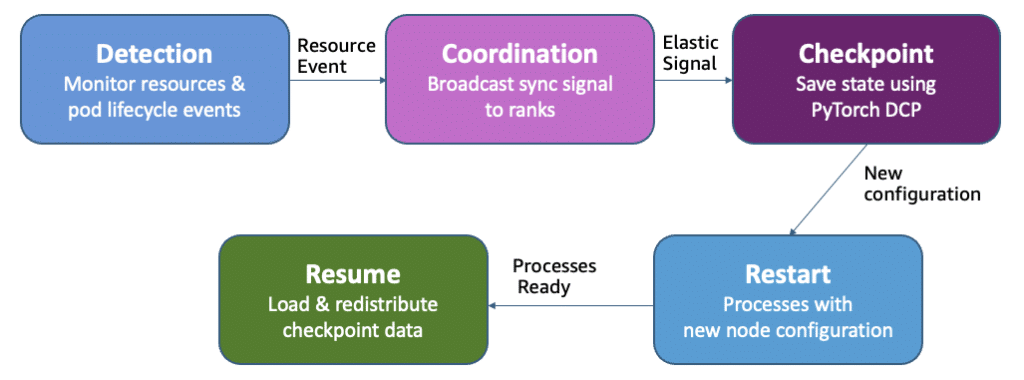

La complejidad del escalado dinámico se ha resuelto mediante la automatización de la orquestación de tareas, eliminando la necesidad de ajustes manuales por parte de los ingenieros de aprendizaje automático. Ahora, SageMaker HyperPod gestiona eficazmente operaciones como la asignación de puntos de control y la reconfiguración de recursos según su disponibilidad. Esto permite que los equipos se enfoquen en el desarrollo de modelos en lugar de en la gestión de infraestructura.

Además, el sistema está diseñado para manejar las solicitudes de recursos de forma más efectiva, priorizando tareas críticas mientras asegura la estabilidad de las operaciones de entrenamiento. Cuando un trabajo de mayor prioridad requiere recursos, SageMaker HyperPod ajusta la cantidad de réplicas en los trabajos de entrenamiento en lugar de detenerlos completamente, logrando así una gestión de recursos más fluida y eficiente.

SageMaker HyperPod se integra con el plano de control de Kubernetes y el programador de recursos, tomando decisiones de escalado basadas en eventos de disponibilidad. Esto permite que el sistema reaccione casi instantáneamente al detectar recursos libres, optimizando el tiempo de despliegue y la utilización de recursos.

Los beneficios son evidentes: una reducción considerable en el desperdicio de recursos y un aumento en la velocidad de desarrollo de modelos. Al eliminar los ciclos de reconfiguración manual, las organizaciones pueden reducir los costos operativos y acortar los tiempos de lanzamiento al mercado de modelos de IA. SageMaker HyperPod se posiciona así como una solución clave para las necesidades en constante cambio de las cargas de trabajo de inteligencia artificial.