En un esfuerzo por expandir los límites de las capacidades de inteligencia artificial (IA) y procesamiento del lenguaje natural en aplicaciones empresariales, el equipo de Model Serving de Salesforce está optimizando modelos de lenguaje de gran tamaño mediante la integración de soluciones avanzadas y la colaboración con líderes tecnológicos. Este ambicioso proyecto no solo aborda modelos de aprendizaje automático tradicionales, sino que también incluye inteligencia artificial generativa, así como modelos de reconocimiento de voz y visión por computadora.

Uno de los principales retos que enfrenta el equipo es gestionar el proceso completo de los modelos, lo que abarca desde la recopilación de requisitos hasta la optimización y escalado de los modelos de IA desarrollados por los equipos de ciencia de datos e investigación de la compañía. Para alcanzar un rendimiento excepcional, es crucial reducir al mínimo la latencia y maximizar el rendimiento mientras se despliegan estos modelos en varias regiones de la nube de Amazon Web Services (AWS).

Entre los desafíos más significativos que enfrenta Salesforce se encuentra el equilibrio entre la latencia y el rendimiento, sin comprometer la eficiencia de costos, todo en un entorno que exige respuestas rápidas y precisas. La optimización del rendimiento de los modelos también debe asegurar la seguridad y la protección de los datos de los clientes, siendo este un aspecto clave de su implementación.

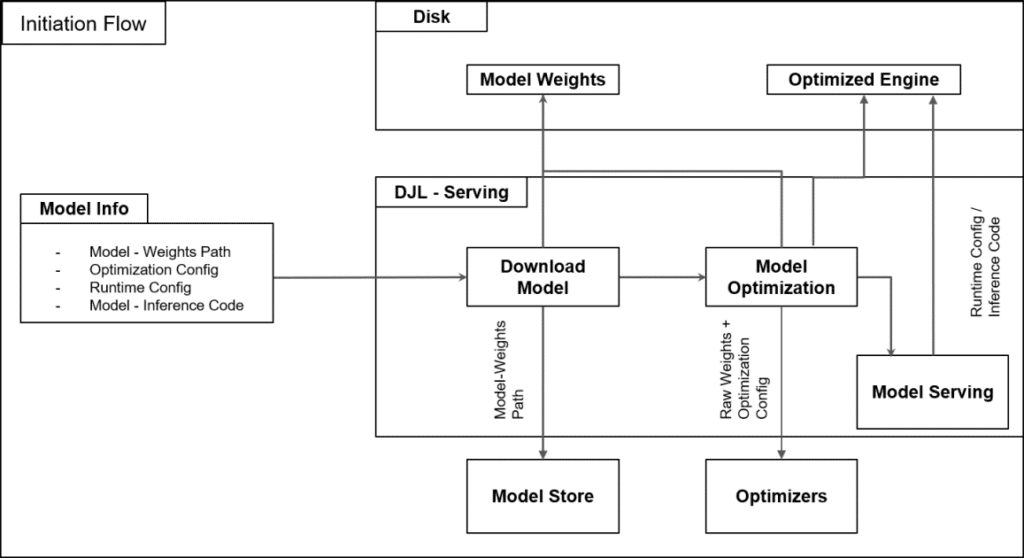

Para superar estos retos, Salesforce ha desarrollado un marco de alojamiento en AWS diseñado para simplificar la gestión del ciclo de vida de los modelos. Utilizando Amazon SageMaker AI, cuentan con herramientas que soportan inferencias distribuidas y despliegues de múltiples modelos, lo que ayuda a evitar cuellos de botella de memoria y a reducir los costos de hardware. SageMaker proporciona contenedores de aprendizaje profundo que aceleran tanto el desarrollo como la implementación, permitiendo que los ingenieros se concentren en la optimización de modelos en lugar de configuraciones de infraestructura.

Además, se han implementado prácticas recomendadas para la configuración en SageMaker AI, que favorecen una utilización óptima de GPU y una mejor asignación de memoria. Esto resulta en un despliegue rápido y eficiente de modelos optimizados, que cumplen con requerimientos de alta disponibilidad y responden con baja latencia.

Con un enfoque modular en el desarrollo, el equipo se asegura de que las mejoras en un proyecto no interfieran con otros. Están explorando varias técnicas de optimización e investigando nuevas tecnologías para mejorar la eficiencia en costos y energía. A través de colaboraciones continuas con la comunidad de código abierto y proveedores como AWS, se aseguran de adoptar las últimas innovaciones.

En cuanto a la seguridad, Salesforce ha establecido estándares estrictos desde el inicio del ciclo de desarrollo, implementando mecanismos de encriptación y controles de acceso para proteger los datos. Mediante pruebas automatizadas, el equipo garantiza que las rápidas implementaciones no comprometan la seguridad.

Conforme las necesidades de IA generativa de Salesforce continúan creciendo, el equipo mantiene su compromiso con la mejora constante de su infraestructura de despliegue, explorando nuevas metodologías y tecnologías para estar a la vanguardia en el campo de la inteligencia artificial.