Las organizaciones que desarrollan aplicaciones de inteligencia artificial generativa se enfrentan al reto de garantizar el rendimiento y la fiabilidad de sus sistemas. En la conferencia AWS re:Invent 2024, se presentó una solución a esta necesidad con el anuncio de las capacidades de evaluación de modelos de lenguaje (LLM-as-a-judge, LLMaJ) y generación aumentada por recuperación (RAG) en versión previa pública. Este avance permitió a los clientes evaluar sus modelos base y aplicaciones de IA generativa. Sin embargo, pronto surgió la demanda de mayor flexibilidad, más allá de lo que ofrecían los modelos de Amazon Bedrock y sus bases de conocimiento.

Respondiendo a esta demanda, Amazon ha lanzado una versión mejorada de Amazon Bedrock Evaluations, que ahora es accesible de manera general al público. Este lanzamiento introduce la funcionalidad «bring your own inference responses» (BYOI) para las evaluaciones de RAG y modelo. En esencia, permite a los usuarios evaluar un sistema RAG o un modelo proporcionado que se ejecute en Amazon Bedrock, otros servicios en la nube, o incluso en local, siempre que los datos de evaluación se presenten en el formato requerido.

Una de las mejoras incluidas es la incorporación de nuevas métricas de citación para fortalecer el conjunto de evaluaciones de RAG, enfocándose en la precisión y cobertura de las citaciones. Esto ayuda a evaluar con precisión cómo un sistema RAG utiliza la información recuperada, lo que es crucial para optimizar el rendimiento y asegurar la calidad en los portafolios de IA generativa.

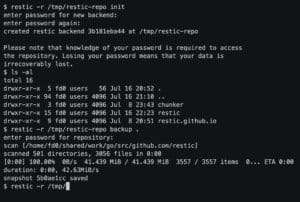

Las capacidades de evaluación han sido adaptadas para permitir la evaluación de salidas de sistemas RAG en cualquier entorno mediante el entorno de evaluación de Amazon Bedrock. La función BYOI posibilita la evaluación de resultados de recuperación y generación provenientes de diversas fuentes, incluyendo proveedores de modelos base alternativos y sistemas RAG personalizados.

Además, se ha actualizado el formato de entrada necesario para la evaluación, que ahora incluye identificadores de bases de conocimiento y campos adicionales de metadatos. Entre las novedades más destacadas se encuentra la introducción de métricas de citación, que ofrecen un análisis detallado sobre la precisión de las citaciones realizadas por un sistema RAG. Esto permite detectar casos en los que las citaciones son innecesarias o irrelevantes.

Con esta evaluación mejorada, las empresas pueden realizar comparaciones efectivas entre diferentes implementaciones, lo que facilita la toma de decisiones informadas basadas en datos sobre los despliegues de IA. Ahora, las organizaciones pueden implementar flujos de trabajo de evaluación regulares, lo que les permite mejorar continuamente sus modelos y sistemas RAG, garantizando así salidas de alta calidad en aplicaciones específicas.