Los modelos de lenguaje grandes (LLMs) han ganado un protagonismo significativo tanto en aplicaciones de consumo como en entornos empresariales. No obstante, su tendencia a generar información incorrecta con gran seguridad ha generado un problema de confianza. Al ser considerados como expertos humanos, es crucial que puedan respaldar sus afirmaciones con referencias fiables. Esta capacidad de citación no solo es aplicable a los humanos, sino también a los LLMs, ya que aumenta su confiabilidad al mostrar su proceso de razonamiento y citar fuentes adecuadas.

Amazon Nova, un modelo lanzado en diciembre de 2024 y disponible en Amazon Bedrock, destaca por ofrecer una solución a este desafío a través del uso de citas. Este enfoque no solo asegura la precisión de la información, dado que los LLMs pueden generar datos erróneos, sino que también fomenta la confianza y la transparencia al permitir que los usuarios verifiquen el origen de la información proporcionada. Además, las citas respetan la propiedad intelectual y previenen el plagio, un aspecto esencial en el uso ético de la inteligencia artificial. También enriquecen la experiencia del usuario al ofrecer rutas para explorar materiales relacionados.

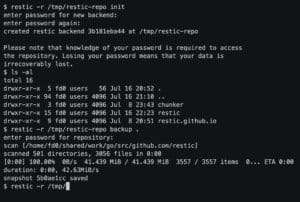

Para maximizar el uso de Amazon Nova, se pueden diseñar preguntas que exijan a los modelos citar sus fuentes. Por ejemplo, al solicitar asesoramiento sobre cartas para accionistas de Amazon, se puede instruir a Nova Pro para que incluya citas de los documentos pertinentes. Esta estrategia permite a los modelos seguir instrucciones precisas y proporcionar respuestas que incorporen las fuentes necesarias.

La evaluación de las respuestas producidas, a su vez, se lleva a cabo mediante otro LLM que actúa como juez, empleando métricas como corrección, completitud y coherencia. Este procedimiento de evaluación proporciona insights valiosos para mejorar las aplicaciones de IA, facilitando el análisis de múltiples variables y asegurando que los resultados sean relevantes y útiles.

En conclusión, la capacidad de Amazon Nova para integrar citas en sus respuestas no solo incrementa la fiabilidad de la información proporcionada, sino que también establece un nuevo estándar de transparencia y ética en la inteligencia artificial. Con la implementación de técnicas de evaluación apropiadas, se garantiza que las interacciones con estos modelos sean más seguras y eficaces.