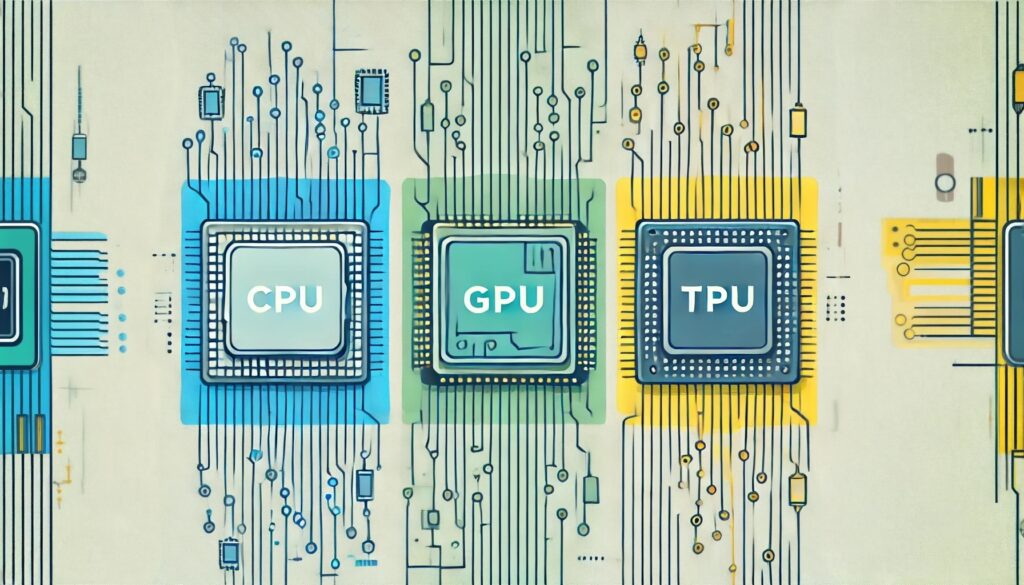

En el mundo de la informática, los procesadores juegan un papel fundamental en el rendimiento y la eficiencia de los dispositivos. A lo largo de la historia, diferentes tipos de procesadores han sido diseñados para abordar tareas específicas: las Unidades de Procesamiento Central (CPU), encargadas de ejecutar la mayoría de las operaciones de un sistema; las Unidades de Procesamiento Gráfico (GPU), optimizadas para gráficos y computación paralela; y las Unidades de Procesamiento Tensorial (TPU), desarrolladas exclusivamente para tareas de inteligencia artificial. En este artículo, exploraremos la evolución y usos de estos procesadores clave en la era digital.

1. CPU: El Corazón de la Computación

Historia y Evolución de las CPU

La CPU (Central Processing Unit) es el componente principal de cualquier sistema informático. Su historia se remonta a mediados del siglo XX, cuando se desarrollaron las primeras computadoras electrónicas.

- Años 1940-1950: Se crean las primeras computadoras basadas en tubos de vacío, como la ENIAC y UNIVAC.

- Años 1960: IBM introduce el IBM System/360, la primera arquitectura de computación escalable.

- Años 1970: Aparece el primer microprocesador comercial, el Intel 4004 (1971), con 2.300 transistores y una frecuencia de 740 kHz.

- Años 1980-1990: Se popularizan los procesadores x86, como el Intel 80386 y el Pentium, que permitieron avances en la informática personal.

- Años 2000-Actualidad: Se desarrollan procesadores multinúcleo, con arquitecturas cada vez más eficientes como los procesadores ARM en dispositivos móviles y la familia Ryzen e Intel Core en PCs.

Funciones Principales de la CPU

La CPU es responsable de interpretar y ejecutar instrucciones a través de sus componentes:

- Unidad de Control (CU): Coordina la ejecución de instrucciones.

- Unidad Aritmético-Lógica (ALU): Realiza cálculos y operaciones lógicas.

- Registros y Caché: Almacenan datos temporales y optimizan el acceso a la memoria.

Usos de las CPU

Las CPU se utilizan en una amplia gama de dispositivos, desde computadoras personales hasta servidores y supercomputadoras. Son esenciales para la ejecución de sistemas operativos, software de oficina, navegadores web, juegos y aplicaciones industriales.

2. GPU: Procesamiento Paralelo y Gráficos Avanzados

Orígenes y Desarrollo de las GPU

Las GPU (Graphics Processing Units) fueron diseñadas inicialmente para acelerar el procesamiento gráfico en videojuegos y aplicaciones visuales. Su evolución ha permitido el desarrollo de la computación paralela.

- Década de 1980: Aparecen los primeros chips gráficos en consolas y PCs (IBM VGA, Commodore Amiga).

- Años 1990: Empresas como NVIDIA y ATI comienzan a fabricar tarjetas gráficas dedicadas, como la RIVA TNT y la Radeon 7000.

- Años 2000: La llegada de la GeForce 256 (1999) y la serie ATI Radeon marcó el inicio de las GPU programables.

- Años 2010-Actualidad: La computación paralela y el desarrollo de arquitecturas como CUDA (NVIDIA) y OpenCL han convertido a las GPU en herramientas clave para la inteligencia artificial y el procesamiento de datos masivos.

Diferencias Claves Entre CPU y GPU

Las GPU están diseñadas para manejar cargas de trabajo paralelas, con miles de núcleos trabajando simultáneamente. A diferencia de las CPU, que se enfocan en tareas secuenciales, las GPU sobresalen en la aceleración de gráficos, simulaciones científicas y modelos de machine learning.

Aplicaciones de las GPU

- Videojuegos y Renderización 3D: Modelado en tiempo real, ray tracing y gráficos fotorrealistas.

- Inteligencia Artificial: Entrenamiento de redes neuronales profundas.

- Minería de Criptomonedas: Cálculos intensivos para blockchain.

- Ciencia y Simulaciones: Aplicaciones médicas, predicciones climáticas y análisis de ADN.

3. TPU: La Nueva Era de la Inteligencia Artificial

Nacimiento de las TPU

Con el auge del aprendizaje automático y la inteligencia artificial, Google desarrolló en 2016 la Tensor Processing Unit (TPU), un chip especializado en acelerar tareas de machine learning.

- TPU v1 (2016): Diseñada para acelerar redes neuronales en Google Search y Google Photos.

- TPU v2 (2017): Introduce memoria de alta velocidad para entrenar modelos de deep learning.

- TPU v3 (2018): Aumenta la capacidad computacional para cargas de trabajo más exigentes.

- TPU v4 (2021): Se enfoca en eficiencia energética y rendimiento extremo en IA.

- TPU Trillium (2024): Última generación con una mejora del 4.7x en rendimiento y un 67% más de eficiencia energética.

Diferencias Entre TPU y GPU

Las TPU están diseñadas exclusivamente para la aceleración de tareas de machine learning. A diferencia de las GPU, que manejan múltiples tipos de cálculos gráficos y computacionales, las TPU están optimizadas para cálculos matriciales de alto rendimiento en redes neuronales.

Casos de Uso de las TPU

- Procesamiento del lenguaje natural: Modelos de IA como Bard o ChatGPT.

- Reconocimiento de imágenes: Aplicaciones en visión artificial y diagnóstico médico.

- Análisis de grandes volúmenes de datos: Optimización en el análisis de datos en la nube.

- Automatización de procesos: Vehículos autónomos y asistentes de voz.

4. Comparación General Entre CPU, GPU y TPU

| Característica | CPU | GPU | TPU |

|---|---|---|---|

| Optimización | Tareas generales | Procesamiento paralelo | Machine Learning |

| Núcleos | Pocos y potentes | Miles de núcleos pequeños | Matrices especializadas |

| Velocidad | Alta en tareas secuenciales | Alta en paralelización | Ultra rápida en IA |

| Uso principal | Sistemas operativos, software general | Videojuegos, simulaciones | Inteligencia artificial |

| Ejemplos | Intel Core, AMD Ryzen | NVIDIA GeForce, AMD Radeon | Google TPU v4, Trillium |

Conclusión: La Sinergia Entre CPU, GPU y TPU

El avance de la tecnología ha llevado a la especialización de los procesadores, permitiendo que cada tipo de chip desempeñe un papel clave en diferentes ámbitos:

- Las CPU siguen siendo esenciales para la mayoría de las aplicaciones informáticas y tareas generales.

- Las GPU han revolucionado el mundo de los videojuegos, la renderización gráfica y la computación científica.

- Las TPU están liderando la era de la inteligencia artificial, acelerando el desarrollo de modelos de aprendizaje profundo.

A medida que la tecnología avanza, es probable que veamos nuevas generaciones de procesadores que combinen lo mejor de cada uno de estos tipos de chips, impulsando aún más la innovación en computación, inteligencia artificial y procesamiento de datos.