En un avance significativo para la inteligencia artificial, el Model Context Protocol (MCP) ha marcado un hito al mejorar la interacción entre modelos de IA y fuentes externas de datos. Este protocolo está diseñado para simplificar y estructurar la manera en que los modelos de lenguaje, como los desarrollados por Mistral AI, acceden a la información externa, permitiendo a los desarrolladores centrarse en la creación de sistemas eficientes y evitando la complejidad de la integración de lógica de recuperación y ejecución de acciones.

Mistral AI, un nuevo laboratorio de investigación abierto, ha lanzado varios modelos innovadores, destacándose por su eficiencia y versatilidad. Gracias a una colaboración con Amazon Web Services (AWS), estos modelos ahora están integrados en servicios como Amazon Bedrock, lo que facilita la creación de aplicaciones potentes a través de un API administrado. Este entorno permite a los usuarios experimentar, escalar e industrializar modelos de Mistral de manera concreta.

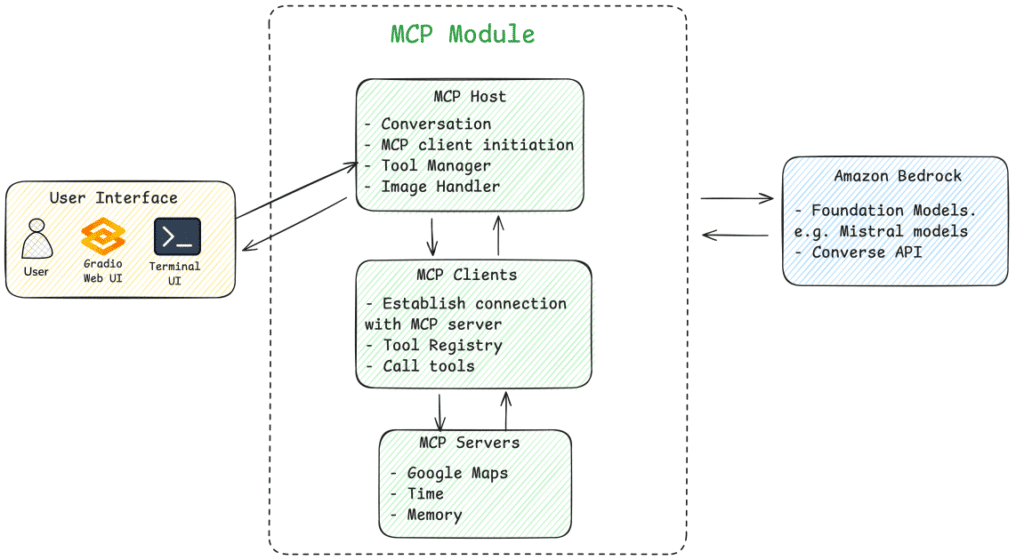

El uso del MCP se ha ejemplificado con la construcción de un asistente de IA inteligente en AWS, capaz de manejar consultas multimodales complejas, como la recomendación de restaurantes. Esta aplicación integra servicios de localización en tiempo real, datos de horarios y memoria contextual, proporcionando respuestas precisas y actualizadas a usuarios que interactúan de diversas maneras.

El flujo de trabajo contempla varias etapas: desde la entrada del usuario hasta el procesamiento de imágenes, incluyendo solicitudes a APIs específicas y la ejecución de herramientas externas. Cada paso maximiza la capacidad del sistema para adaptarse a las necesidades del usuario. En el contexto de la recomendación de restaurantes, el asistente puede, por ejemplo, determinar horarios de apertura basándose en la ubicación y la hora actual del usuario.

La implementación del MCP en los modelos de Mistral incluye la posibilidad de que los desarrolladores ajusten configuraciones y añadan servidores MCP específicos para personalizar la experiencia según sus necesidades. Esto abre un amplio rango de aplicaciones en diversas industrias.

Para aquellos que buscan una implementación más sencilla, se ha presentado el marco Strands Agent, que reduce la complejidad del proceso de codificación y facilita la creación de aplicaciones que operan en conjunto con el MCP.

El potencial de esta tecnología es enorme, incrementando la velocidad de desarrollo y el rendimiento de aplicaciones de IA, al tiempo que mantiene la separación entre la lógica de razonamiento de la IA y la ejecución de herramientas externas. Con esta integración, se espera que más organizaciones adopten sistemas de IA que no solo interactúan con datos en tiempo real, sino que también toman acciones significativas basadas en el análisis de esos datos.