En un mundo donde la cantidad de contenido de video sigue aumentando, la capacidad de realizar búsquedas eficientes a través de lenguaje natural se ha vuelto esencial tanto para empresas como para usuarios individuales. La búsqueda semántica de video ofrece una solución efectiva a este desafío, permitiendo a los usuarios encontrar contenido relevante mediante consultas textuales o descripciones. Este enfoque tiene aplicaciones diversas, desde bibliotecas personales de fotos y videos hasta la edición profesional de video y la moderación de contenido a nivel empresarial.

El preentrenamiento masivo de modelos de visión por computadora, utilizando autoetiquetado a partir de descripciones en lenguaje natural, ha facilitado la captura de un amplio espectro de conceptos visuales, eliminando la necesidad de anotaciones manuales. Tras este preentrenamiento, es posible utilizar descripciones naturales para referirse a los conceptos visuales aprendidos o para describir nuevos, lo cual permite una transferencia directa a múltiples tareas de visión por computadora, como la clasificación de imágenes y el análisis semántico.

Investigaciones recientes han demostrado el uso de modelos de visión a gran escala para la búsqueda semántica de videos, ofreciendo métodos específicos como el suavizado temporal y el agrupamiento para mejorar los resultados. Este enfoque se implementa utilizando Amazon SageMaker para el procesamiento de video, imágenes y texto, junto con el motor vectorial de Amazon OpenSearch Serverless, que permite realizar búsquedas semánticas de video con baja latencia.

La implementación de la búsqueda de video combina modalidades textuales y visuales, utilizando técnicas avanzadas de aprendizaje multimodal para aprender una variedad de conceptos visuales de bases de datos extensas. Esto resulta en la capacidad de resolver diversas tareas de visión por computadora sin necesidad de ajustes específicos.

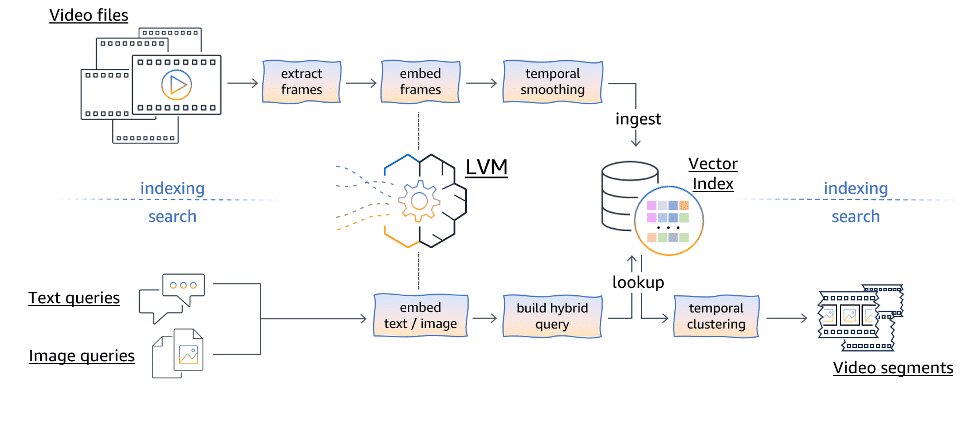

El diseño de esta solución se divide en un proceso de indexación y la lógica de búsqueda de video en línea. El proceso de indexación maneja la extracción de fotogramas individuales de los videos y su mapeo en representaciones vectoriales de alta dimensión, permitiendo capturar la información semántica del contenido.

La búsqueda semántica permite consultas textuales o visuales, que son integradas en un espacio de representación multimodal. Esto no solo facilita la búsqueda de fotogramas según su similitud conceptual con la consulta, sino que también incorpora técnicas de agrupamiento temporal que organizan fotogramas en segmentos con sentido semántico.

Esta solución ha sido evaluada en diversos casos de uso, destacando su eficacia para identificar momentos clave en eventos deportivos y otras tareas específicas en videos extensos. Los resultados subrayan la calidad y variedad de las búsquedas, evidenciando un equilibrio entre calidad, diversidad y eficiencia computacional, mejorando la experiencia del usuario en la búsqueda semántica de videos. A medida que el contenido digital sigue expandiéndose, estas herramientas se volverán esenciales para gestionar y descubrir información efectivamente.