Aviva, una de las aseguradoras más reconocidas a nivel mundial, ha conseguido un importante avance tecnológico con la implementación de una plataforma MLOps completamente sin servidores. Esta iniciativa tiene como objetivo mejorar los procesos operativos de la compañía y ofrecer experiencias optimizadas a sus más de 33 millones de clientes distribuidos en 16 países a través del uso de inteligencia artificial y aprendizaje automático.

Gracias a la colaboración con Amazon Web Services (AWS), Aviva ha creado esta plataforma utilizando el Marco de MLOps Empresarial de AWS y Amazon SageMaker. Esta solución innovadora integra las mejores prácticas de DevOps dentro del ciclo de vida del aprendizaje automático, lo que permite estandarizar el desarrollo de modelos, optimizar su despliegue y asegurar un monitoreo constante de su rendimiento en producción.

Uno de los principales desafíos que enfrentan las organizaciones cuando implementan modelos de machine learning es la operación y el despliegue a gran escala. Según un estudio de Gartner, casi la mitad de los proyectos de ML no logran llegar a producción. Sin embargo, Aviva ha superado este reto, lo que le ha permitido gestionar de manera eficiente alrededor de 400,000 reclamos de seguros al año y soportar una carga de trabajo creciente.

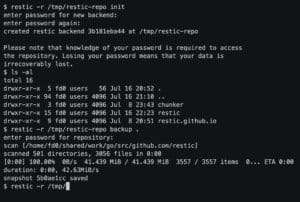

Para demostrar la efectividad de su nueva plataforma, Aviva ha implementado el caso de uso «Remedy», un sistema de gestión de reclamaciones. Este sistema calcula si las reclamaciones de seguros de automóviles califican como pérdida total o si son reparables, tomando en cuenta los costos estimados de reparación, el valor de mercado del vehículo y otros datos relevantes. Esto proporciona recomendaciones precisas a los gestores de reclamos.

El éxito obtenido con «Remedy» no solo se considera un modelo para futuros proyectos, sino que también evidencia el potencial de la plataforma para manejar la industrialización de modelos de ML mediante soluciones preconfiguradas. La arquitectura modular de la plataforma se divide en bloques que incluyen redes y plantillas de proyectos de Amazon SageMaker. Estos bloques se implementan en cuentas de AWS específicas para desarrollo, pruebas y producción, lo que simplifica la promoción de modelos con procesos coherentes en todas las etapas.

El flujo de trabajo del modelo de inferencia combina predicciones del modelo, datos externos y lógica de negocios para generar recomendaciones para los gestores de reclamos. El sistema categoriza los vehículos descartados, los que pueden repararse o aquellos que requieren investigación adicional, asegurando decisiones basadas en una información sólida y completa.

Con esta nueva solución, Aviva ha conseguido reducir los costos de infraestructura en un impresionante 90% en comparación con su anterior solución de ML local. Esta transformación ha permitido a la empresa desplegar cientos de casos de uso de ML en cuestión de semanas, en lugar de meses, fortaleciendo así su capacidad de innovación y adaptación en el competitivo sector de servicios financieros.