Anthropic ha convertido una de las ideas más repetidas en el desarrollo asistido por Inteligencia Artificial en una herramienta lista para usar dentro de GitHub. Su proyecto claude-code-action permite llevar Claude Code a pull requests, issues y comentarios, de forma que el asistente pueda responder preguntas sobre el código, revisar cambios e incluso proponer o implementar modificaciones directamente dentro del flujo de trabajo del repositorio. El repositorio oficial, publicado bajo licencia MIT, supera ya las 6.200 estrellas, ronda los 1.500 forks y acumula 494 commits, una señal clara de que no se trata de una simple demo, sino de una pieza que Anthropic quiere consolidar dentro del ecosistema de automatización para desarrollo.

La propuesta tiene bastante lógica en el contexto actual. El desarrollo asistido por IA ya no se limita al editor o a la terminal. Muchas empresas quieren que el modelo también participe en la conversación de equipo, en la revisión de código y en procesos repetitivos de mantenimiento. Ahí es donde entra esta action: permite que Claude opere dentro de GitHub Actions y decida automáticamente cómo actuar según el contexto del workflow, ya sea respondiendo a una mención tipo @claude, reaccionando a una asignación en una issue o ejecutando una automatización basada en prompts explícitos. Anthropic lo presenta como una action de propósito general para PRs e issues, con detección inteligente de modo de ejecución.

Una action para revisar, responder y tocar código

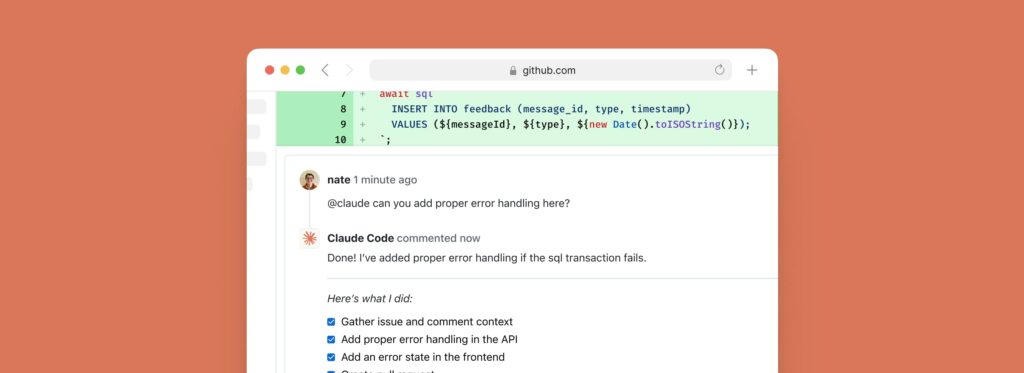

Lo más llamativo del proyecto es que no se queda en la simple respuesta textual. Según su README oficial, la action puede actuar como asistente interactivo de código, revisor de PRs y herramienta de implementación, con capacidad para responder dudas sobre arquitectura o programación, analizar cambios en una pull request y aplicar arreglos sencillos, refactorizaciones o incluso nuevas funciones. Además, incluye seguimiento visual del progreso mediante checkboxes dinámicos y salidas estructuradas en JSON que pueden reutilizarse en automatizaciones más complejas dentro del propio pipeline.

Anthropic también subraya otro punto importante: la ejecución se realiza en la infraestructura del propio usuario, es decir, en el runner de GitHub elegido por la organización. Las llamadas al modelo viajan al proveedor configurado, pero la action no funciona como un servicio externo cerrado que secuestra el proceso completo. Esa idea puede resultar especialmente atractiva para equipos que quieren mantener mayor control operativo sobre dónde corre la automatización y qué permisos exactos se conceden durante el flujo.

La compatibilidad en autenticación también es amplia. Además de la API directa de Anthropic, la action admite Amazon Bedrock, Google Vertex AI y Microsoft Foundry, algo que encaja con una realidad cada vez más evidente en la empresa: no todas las organizaciones quieren consumir modelos desde un único proveedor ni todas pueden usar acceso directo al servicio original. Anthropic intenta así colocar Claude Code Action en entornos híbridos donde el modelo puede llegar a través de distintos canales empresariales.

Quickstart sencillo, pero con varios matices

El arranque está pensado para ser relativamente simple. Anthropic indica que la forma más fácil de instalar la action es abrir Claude Code en terminal y ejecutar el comando /install-github-app, que guía al usuario durante la instalación de la GitHub App y la configuración de secretos. Pero esa facilidad tiene un matiz importante: ese método rápido solo está disponible para quienes usan la API directa de Anthropic. Para entornos sobre AWS Bedrock, Vertex AI o Microsoft Foundry, la documentación remite a una guía específica de proveedores cloud. Además, para seguir este flujo rápido el usuario debe ser administrador del repositorio.

En la guía de uso, Anthropic muestra que el workflow puede activarse con eventos como issue_comment, pull_request_review_comment, issues y pull_request_review, lo que cubre buena parte de la interacción normal dentro de un repositorio. También permite personalizar el disparador, cambiando la frase por defecto @claude por otra distinta, además de activar el sistema mediante asignaciones o etiquetas en issues. En otras palabras, no se limita a un único patrón de uso: puede comportarse como asistente bajo demanda o como pieza más automatizada de un pipeline.

La seguridad es parte central del discurso

Uno de los aspectos más interesantes del proyecto está en su documentación de seguridad, bastante más explícita de lo habitual en herramientas de este tipo. Anthropic señala que, por defecto, la action solo puede activarse por usuarios con permisos de escritura en el repositorio y que los bots y GitHub Apps quedan bloqueados salvo que se habiliten expresamente mediante el parámetro allowed_bots. La advertencia es clara: si se configura allowed_bots='*' en un repositorio público, aplicaciones externas podrían disparar workflows con prompts bajo su control. Por eso la documentación recomienda usar listas explícitas y reducir al mínimo los permisos del workflow.

La documentación también avisa de que el parámetro allowed_non_write_users es arriesgado porque permite saltarse la comprobación principal de permisos. Anthropic lo justifica solo para automatizaciones con permisos muy acotados, como flujos de etiquetado de issues, e insiste en que debe usarse con extrema precaución. Es un aviso relevante porque deja entrever uno de los mayores riesgos de este tipo de integraciones: no tanto el modelo en sí, sino lo que puede llegar a hacer si el workflow queda demasiado abierto o demasiado expuesto a entradas no confiables.

Otro punto sensible es el de la inyección de prompts. Anthropic reconoce que un colaborador externo podría intentar introducir instrucciones ocultas en contenido aparentemente inocuo mediante comentarios HTML, caracteres invisibles, atributos ocultos u otras técnicas. La action aplica medidas de saneamiento sobre la entrada, pero la propia documentación admite que pueden aparecer nuevos métodos de evasión. Por eso recomienda revisar el contenido en bruto cuando se trabaja con contribuciones externas o entornos menos confiables.

Comandos útiles, pero con límites bastante claros

La documentación de seguridad también aclara varias decisiones operativas que muestran hasta qué punto Anthropic intenta equilibrar automatización y control humano. En su configuración por defecto, Claude no crea automáticamente la pull request al responder a una mención. En lugar de eso, hace los cambios en una rama nueva y devuelve un enlace para que sea una persona quien abra la PR manualmente. La compañía presenta esto como una forma de mantener supervisión humana antes de iniciar formalmente el flujo de revisión y merge.

También hay controles sobre la exposición de datos. La opción show_full_output viene desactivada por defecto por razones de seguridad, ya que podría mostrar contenido sensible procedente de herramientas, comandos o lecturas de ficheros dentro de los logs de GitHub Actions, algo especialmente delicado en repositorios públicos. Anthropic recomienda apoyarse en la salida saneada por defecto y dejar el volcado completo solo para entornos privados, de depuración y con plena consciencia del riesgo. La guía va incluso más allá y recuerda de forma explícita que nunca deben hardcodearse claves de API u otros tokens en los workflows, sino almacenarse siempre como GitHub secrets.

Por último, la action ofrece dos opciones de commit signing: una basada en la propia API de GitHub, que genera commits verificados desde la GitHub App, y otra basada en SSH signing key para quienes necesiten firmar commits manteniendo operaciones git más complejas como rebase o cherry-pick. Ese detalle refuerza la idea de que Anthropic no está pensando solo en un juguete de laboratorio, sino en un flujo que pueda encajar en repositorios donde la gobernanza del código y la trazabilidad del autor siguen siendo importantes.

En conjunto, claude-code-action representa un paso bastante claro en la carrera por llevar los agentes de desarrollo desde el editor hasta la capa social y operativa de GitHub. La gran cuestión ya no es si la IA puede sugerir código, sino cómo se integra de forma segura y útil en los procesos reales de revisión, conversación y automatización. Anthropic ha decidido jugar esa partida con una action abierta, bastante documentada y con un discurso de seguridad inusualmente explícito. Ahora falta ver hasta qué punto los equipos confían en ella para darle más espacio dentro de sus repositorios.

Preguntas frecuentes

¿Qué hace exactamente Claude Code Action en GitHub?

Permite que Claude responda a preguntas sobre código, revise pull requests, sugiera mejoras e incluso implemente cambios dentro de PRs e issues usando GitHub Actions.

¿Cómo se activa Claude dentro de un repositorio con esta action?

Puede activarse con eventos como comentarios en issues, comentarios de revisión en PRs, revisiones de pull requests, asignaciones o etiquetas. Por defecto, la frase disparadora es @claude, aunque puede personalizarse.

¿Qué proveedores de autenticación soporta Claude Code Action?

Soporta la API directa de Anthropic y también integraciones con Amazon Bedrock, Google Vertex AI y Microsoft Foundry.

¿Qué riesgos de seguridad señala la propia documentación?

Anthropic advierte sobre la apertura excesiva a bots, el uso arriesgado de allowed_non_write_users, posibles ataques de prompt injection en contenido no confiable y la exposición de datos sensibles si se activa la salida completa del workflow.