Los modelos de lenguaje de gran tamaño (LLMs) se han convertido en herramientas esenciales en el campo del procesamiento del lenguaje natural, gracias a su capacidad para comprender y generar textos similares al lenguaje humano. Sin embargo, la demanda de potencia computacional que requieren plantea desafíos significativos, especialmente en ámbitos que exigen baja latencia como la traducción en tiempo real y los asistentes de voz conversacionales.

En un esfuerzo por superar estas limitaciones, investigadores han desarrollado un marco llamado Medusa, diseñado para acelerar significativamente la inferencia de LLMs. Medusa introduce cabezas adicionales en los modelos para predecir múltiples tokens simultáneamente, permitiendo así duplicar la velocidad de inferencia sin sacrificar la calidad del modelo. En pruebas recientes con Medusa-1, se ha demostrado una mejora en la velocidad de hasta 1.8 veces para ciertos tamaños de modelos y conjuntos de datos, lo que representa un avance notable en la eficiencia de estos sistemas.

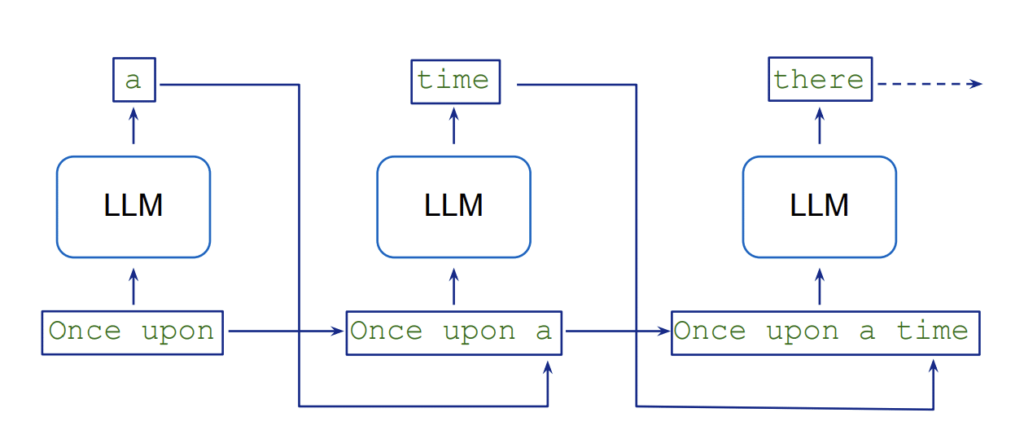

El proceso tradicional de generación de texto en LLMs es secuencial, lo que implica latencias inherentes debido a la dependencia de cada nuevo token de los anteriores. Este método secuencial no solo consume tiempo sino también altos recursos. Medusa, en lugar de seguir la ruta común de la «decodificación especulativa» que usa un modelo más ligero para prever continuaciones paralelas, elimina esta necesidad inicial al equipar al modelo principal con cabezas de decodificación capaces de generar candidatos simultáneamente. Este enfoque reduce significativamente los pasos secuenciales necesarios.

El marco Medusa ha mostrado potenciales aumentos de velocidad de hasta 2.8 veces dependiendo del tamaño y complejidad del modelo. Actualmente, es compatible con modelos como Llama y Mistral, aunque la implementación podría requerir mayor cantidad de memoria debido a las cabezas añadidas. Por otra parte, entrenar estas cabezas adicionales demanda considerablemente tiempo y recursos, aspectos que deben tenerse en cuenta al planificar proyectos. Es importante destacar que Medusa admite únicamente un tamaño de lote de uno, haciéndolo especialmente útil para aplicaciones que buscan minimizar la latencia.

Mediante una serie de pasos que integran desde la preparación de conjuntos de datos hasta la implementación final en un endpoint de Amazon SageMaker AI, Medusa promete acelerar la inferencia de LLMs, contribuyendo a tiempos de respuesta más ágiles y una mejor experiencia del usuario. A medida que más empresas exploran el potencial de los LLMs, optimizar su rendimiento con innovaciones como Medusa será esencial para afrontar los desafíos de operatividad y calidad en la generación automatizada de textos.